همهی مدلهای زبانی هوش مصنوعی مانند ChatGPT سیاست حریم خصوصی و همچنین نحوه استفاده از اطلاعات کاربران را به صورت نسبتاً شفافی بیان میکنند. در بسیاری از موارد کاربر میتواند با تغییرات جزئی جلوی انتشار اطلاعات شخصی خود را برای آموزش مدلهای زبانی هوش مصنوعی بگیرد. برای استفاده ایمن از ChatGPT در ادامه همراه ما باشید.

آیا ChatGPT اطلاعات ما را به اشتراک میگذارد؟

به صورت کلی همهی مدلهای زبانی بزرگ مثل: Gemini، چتGPT و گروک قوانین مربوط به حریم خصوصی خاص خود را دارند. تقریباً تمامیمدلهای زبانی بزرگ (LLM) در شرایط استفاده قید میکنند که شما با استفاده از چتبات هوش مصنوعی ما، نسبت به استفاده از اطلاعات وارد شده به هوش مصنوعی برای آموزش مدلهای شرکت و همچنین بهبود مدلهای فعلی هوش مصنوعی مشکلی ندارید. همین بند به شرکتهای هوش مصنوعی اجازه میدهد اطلاعات شما را ذخیره و از آنها استفاده کنند.

عموم شرکتهای بزرگ و همچنین ارگانهای حساس مثل مراکز نظامی یا مدلهای اختصاصی هوش مصنوعی خود را طراحی میکنند یا اینکه از شرکتهای بزرگ هوش مصنوعی میخواهند تا یک مدل زبانی کاملا مستقل در اختیار آنها قرار دهد. مثلا شرکت OpenAI برای دولت ایالات متحده مدلهای اختصاصی ایجاد و در اختیار آنها قرار داد که اطلاعات حساس آنها ایمن باشد.

برای حفظ حریم خصوصی در تعامل با AI چه اطلاعاتی حساس هستند؟

در ابتدا باید بدانیم که طبق گفتهی شرکتهای هوش مصنوعی نظیر Open AI، گوگل و xAI (شرکت هوش مصنوعی Grok)، به طور کلی وارد کردن اطلاعاتی که در صورت افشای آنها ممکن است شما ناراحت شوید به مدلهای زبانی بزرگ (LLM) توصیه نمیشود.

اطلاعات حساسی که نباید در اختیار چتباتها قرار گیرد مثل: مدارک حساس پزشکی شما، آدرس محل سکونت، مشخصات هویتی نظیر کد ملی یا کد گذرنامه، اطلاعات بانکی مثل موجودی حساب، شماره کارت بانکی و حتی رسیدهای پرداختی شما هستند. رمزهای عبور یا کلیدهای دسترسی به نرمافزارهای خاص و موارد مشابه نیز بهتر است در اختیار این مدلهای زبانی قرار نگیرند.

روشهای استفاده ایمن از ChatGPT:

برای حفظ حریم خصوصی در استفاده از AI به روشهای زیر که در ادامه میگوییم عمل کنید.

در این مطلب چون ChatGPT نسبت به بقیه مدلهای هوش مصنوعی فراگیرتر است، به آموزش استفاده ایمن از ChatGPT پرداختهایم ولی سایر چتباتها نیز تنظیمات مشابهای را در اختیار ما قرار میدهند.

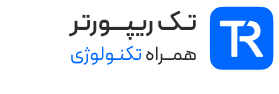

روش اول: استفاده از چت موقت (Temporary Chat)

ابتدا برای امنیت دادهها در چتباتها میتوان در سادهترین حالت از گزینهی بالای صفحه در سمت راست که در تصویر زیر میبینید استفاده کرد. این گزینه Temporary Chat (چت موقت) نام دارد. گزینه چت موقت همانند صفحهی جستجوی ناشناس (Incognito window) در مرورگر کروم یا مایکروسافت edge است.

این حالت به شما امکان میدهد بدون اینکه این چت در سابقه (history) گفتوگوی شما ذخیره شود، با هوش مصنوعی مکالمه انجام دهید. علاوه بر آن اطلاعات وارد شده شما در این حالت کش هم نمیشوند. شاید بگوید کش هوش مصنوعی چیست.

تقریبا همهی مدلهای هوش مصنوع مطرح برای اینکه بتوانند تجربه بهتری را برای کاربران ایجاد کنند، بعضی از اطلاعات افراد را ذخیره میکنند. مثلا ممکن است نام شما را در یکی از مکالماتتان به خاطر بسپارد و شما را با آن اسم خطاب کند. رنگ مورد علاقه و حتی میزان تحصیلات شما را ذخیره کند و با توجه به این مشخصه در مکالمات یا سوالاتی که میپرسید این مورد را لحاظ کند.

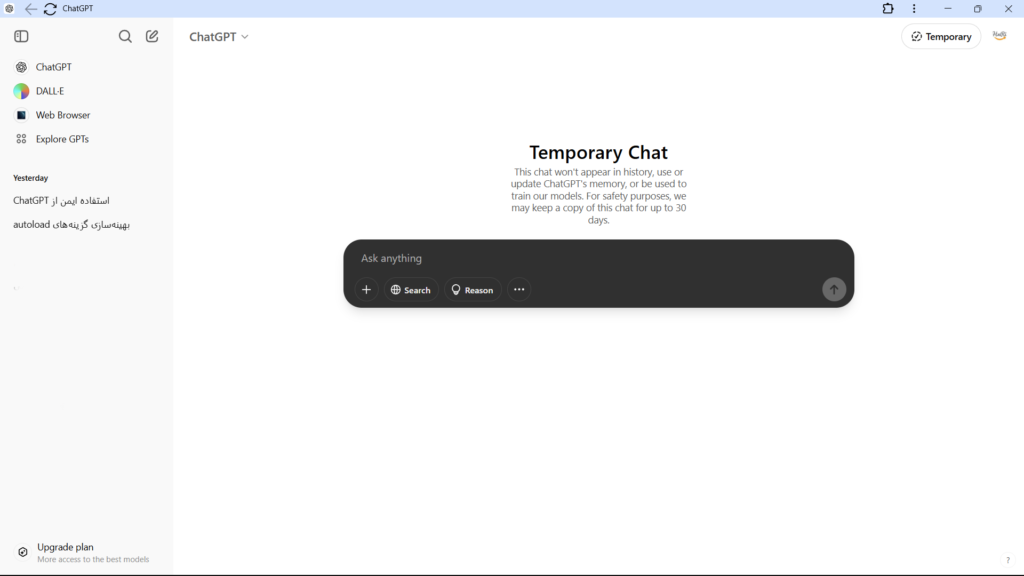

روش دوم: خاموش کردن یا حذف اطلاعات کش شده

در روش قبل به اطلاعات کش شده پرداختیم، اگر بخواهیم این قابلیت را خاموش یا اطلاعاتی که از ما ذخیره شده را حذف کنیم باید به تب Personalization بروید و در آنجا گزینه Memory را خاموش کنید. این گزینه در استفاده ایمن از ChatGPT به شما کمک میکند و دیگر چتبات هیچ اطلاعاتی از قبیل گزینههای مورد علاقه شما، شغل، تاریخ تولد و اطلاعاتی از این قبیل پروژههایی را که با هوش مصنوعی در میان گذاشتهاید را ذخیره نمیکند.

اگر AI اطلاعاتی را از شما جمعآوری و کش کرده باشد میتوانید در تب Personalization با استفاده از گزینهی Manage memories اقدام به حذف این دادهها کنید.

روش سوم: قطع دسترسی AI برای آموزش با دادههایما

برای حفظ حریم خصوصی در تعامل با AI و مدلهای مختلف هوش مصنوعی بهتر است سراغ خاموش کردن اجازه استفاده از اطلاعات خودمان که به چتباتها میدهیم برای جلوگیری از آموزش مدلهای هوش مصنوعی استفاده کنیم.

برای استفاده ایمن از ChatGPT باید در تنظیمات به سراغ بخش Data controls برویم. با توجه به اینکه مدلهای زبانی فعلی هوش مصنوعی در حال حاضر عموماً چند وجهی هستند؛ تعامل کاربران علاوه بر گفتوگوهای متنی به صورت صوتی و حتی تعاملات تصویری نیز میتواند باشد. مدلهای زبانی هوش مصنوعی با اجازه ضمنی که در ابتدای ثبتنام از شما میگیرند این اجازه را به خود میدهند تا از دادههای شما برای آموزش مدلهای زبانی بعدی خود و همچنین بازخوردگیری از مدلهای فعلی استفاده کنند.

برای خاموش کردن این گزینهها به بخش دیتا کنترل میرویم و همانطور که در تصویر مشاهده میکنید ۳ گزینه برای شما در دسترس است. با خاموش کردن گزینه Improve the models for everyone، اجازه استفاده از اطلاعات شما برای بهبود هوش مصنوعی و حتی آموزش مدلهای زبانی بعدی گرفته میشود.

دو گزینه دیگر با خاموش کردن این مورد به صورت خودکار غیرفعال میشوند که یکی مربوط به ویدیو و یکی هم مکالمات یا ویسهای ارسالی است.

روش چهارم: نشستهای فعال و تایید دو مرحلهای

تب Security نیز مورد دیگری است که میتوانید آن را برای استفاده ایمن از ChatGPT بررسی کنید. اگر شک دارید کسی به حساب چت GPT شما متصل است، برای حفظ امنیت دادهها در چتباتها میتوانید با گزینه Log out all همهی دستگاههای متصل به حساب خود را غیرفعال کنید. در نهایت داخل همین زبانه امنیت قادر هستید با استفاده از گزینهی multi factor authentication، تنظیمات ورود دو مرحلهای را نیز برای حفظ حریم خصوصی در تعامل با AI فعال کنید.

در نظر داشته باشید موارد گفته شده در تنظیمات سایر مدلهای زبانی هوش مصنوعی مثل: جمنای گوگل، claude آنتروپیک و حتی copilot با کمی اضافات یا تغییرات وجود دارند و به شما کمک میکنند که اطلاعات شما امنیت بهتری در استفاده از چتباتهای هوش مصنوعی داشته باشند.

آیا استفاده اطلاعات ورودی ما به چت GPT کاملاً ایمن است؟

به طور کلی از این نکته غافل نباشید که امنیت ۱۰۰٪ در دنیای فعلی تضمینی نیست و هرچیزی که وارد فضای اینترنت شود ممکن است در معرض آسیب باشد. بتازگی با مهمتر شدن بحث امنیت دادههای کاربران، شرکت Open AI (مالک چتبات GPT) جوایزی را برای گزارش مشکلات امنیتیاش تعیین کرد. این نشان میدهد حفظ امنیتدادههای کاربران در چتباتهای هوش مصنوعی اهمیت ویژهای پیدا کرده.

توجه داشته باشید امنیت شرکتهای هوش مصنوعی و همچنین صداقت آنها در عدم استفاده از اطلاعات شما با خاموش کردن موارد گفته شده در مقاله، یا استفاده از چت موقت موضوع دیگری است که ممکن است توسط چتباتها نقض شود؛ در نتیجه اگر درز اطلاعاتی ممکن است برای حریم خصوصی شما، سازمان و حتی موقعیت شغلی شما خطرناک باشد بهتر است با انجام این تنظیمات بازهم جانب احتیاط را رعایت کنید.